[AI] 라마3 한국어 pretrained 모델 사용 경험

며칠전 준범님이 공개한 Llama-3-Open-Ko-8B 모델을 직접 사용해 본 경험을 공유하고자 합니다.

Llama-3-Open-Ko-8B는 Llama-3-8B를 기반으로 한국어 데이터로 사전 학습(pretrained)된 모델입니다.

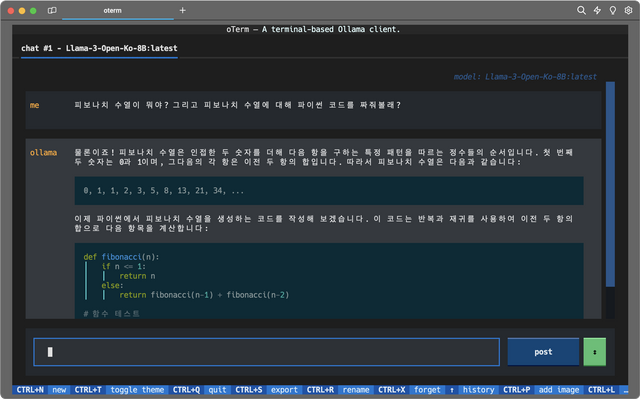

코드 작성 요청

작은 모델인데도 불구하고 코드 작성 능력이 나쁘지 않은 듯...

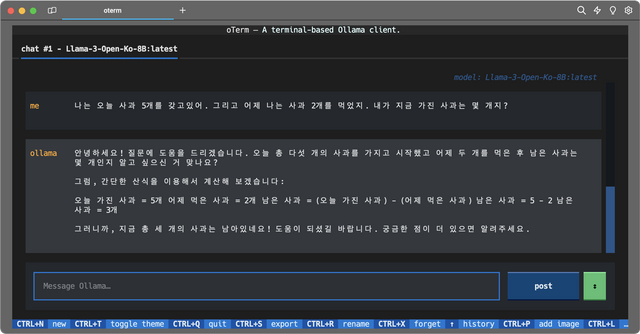

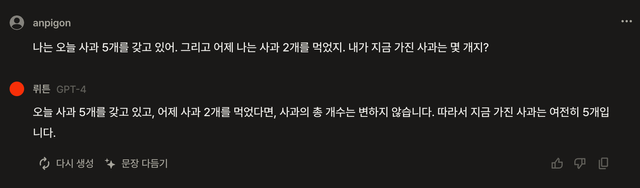

수학 능력 및 논리적 사고

이 정도라도 괜찮다⋯

아래 GPT-4 답변과 비교

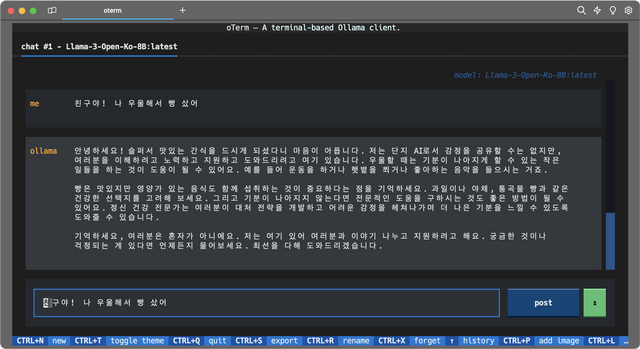

MBIT 검사

라마3는 MBTI가 F 인듯... 감성적⋯

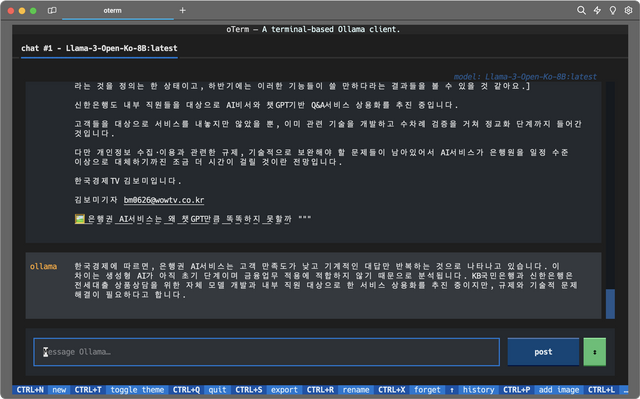

기사 요약

이제 요약에는 이 AI 모델을 사용해야겠다.

마치며

지금까지 사용해본 한국어 로컬 LLM 중에서 Llama-3-Open-Ko-8B의 성능이 가장 뛰어난것 같습니다. 그리고 이 모델은 GPT-3.5-Turbo와 비슷한 수준의 성능을 제공한다고 생각해요.

AI 관련 글

- [AI] Joplin 노트에 GPT-4를 무료로 활용하는 방법

- [개발] Gemini 1.5 Pro으로 문서 요약

- 옵시디언 노트 기반 RAG 시스템 구축하기 4 (마지막)

- [AI] Meta Llama 3 8B AI모델 사용 경험

- [AI] 한국어 로컬 LLM 비교

[광고] STEEM 개발자 커뮤니티에 참여 하시면, 다양한 혜택을 받을 수 있습니다.

Congratulations, your post has been upvoted by @upex with a 0.20% upvote. We invite you to continue producing quality content and join our Discord community here. Keep up the good work! #upex